Tag cloud atau awan tag adalah representasi visual dari kata-kata kunci atau tag yang paling umum digunakan dalam suatu dokumen atau set dokumen. Tag cloud biasanya terdiri dari sekelompok kata-kata yang ditampilkan dalam ukuran yang berbeda-beda, dengan ukuran yang lebih besar menunjukkan bahwa kata-kata tersebut lebih sering muncul dalam dokumen atau set dokumen yang dianalisis. Tag cloud digunakan untuk membantu pengguna memperoleh pemahaman yang lebih cepat tentang topik atau konten dokumen yang dianalisis.

Berikut ini kita coba membuat tagcloud dari scrapping www.newsapi.org yang merupakan platform penyedia layanan berita berbasis web (lihat pos terdahulu). Layanan ini menyediakan akses ke ribuan artikel berita dari berbagai sumber terpercaya di seluruh dunia. NewsAPI.org adalah salah satu layanan terbaik untuk pengembang dan pembuat aplikasi yang ingin mengintegrasikan berita ke dalam aplikasi mereka. Berikut ini adalah contoh akses API:

https://newsapi.org/v2/top-headlines?country=id&apiKey=APIKEY

Untuk mendapatkan API Key dari NewsAPI.org, ikuti langkah-langkah berikut:

-

Kunjungi situs web NewsAPI.org di https://newsapi.org/.

-

Klik tombol “Get API Key” di sudut kanan atas halaman web.

-

Isi formulir pendaftaran yang tersedia dengan alamat email Anda dan kata sandi yang aman, kemudian klik “Get Started”.

-

Verifikasi alamat email Anda dengan mengklik tautan yang dikirimkan ke email Anda.

-

Login ke akun NewsAPI.org yang baru saja Anda buat.

-

Setelah login, klik “Dashboard” untuk melihat API Key Anda.

-

Salin API Key yang ditampilkan dan gunakan dalam permintaan API Anda.

Perlu diingat bahwa NewsAPI.org menyediakan berbagai paket layanan dengan harga yang berbeda-beda. Paket gratis memiliki batasan permintaan API per hari, sedangkan pada paket berbayar, batasan permintaan dan fitur yang lebih banyak tersedia. Pastikan untuk memilih paket yang sesuai dengan kebutuhan Anda. Berikut ini terapannya untuk membuat Tagcloud.

<!DOCTYPE html>

<html>

<head>

<title>Tag Cloud dari Scraping NewsAPI</title>

</head>

<body>

<h1>Tag Cloud dari Scraping NewsAPI</h1>

<?php

$apiUrl = “https://newsapi.org/v2/top-headlines?country=id&apiKey=API KEY“; // Ubah kode “id” menjadi kode negara yang ingin Anda scrap beritanya

$response = file_get_contents($apiUrl); // Ambil data dari NewsAPI dalam format JSON

$newsData = json_decode($response); // Ubah data JSON menjadi objek PHP

$tags = array(); // Buat array kosong untuk menyimpan tag yang diambil dari berita

foreach ($newsData->articles as $article) { // Loop setiap artikel dalam objek berita

$title = strtolower($article->title); // Ambil judul artikel dan ubah ke huruf kecil

$words = explode(” “, $title); // Pisahkan kata-kata dalam judul artikel ke dalam array

foreach ($words as $word) { // Loop setiap kata dalam array

if (strlen($word) > 3) { // Jika kata lebih panjang dari 3 karakter

array_push($tags, $word); // Tambahkan kata ke dalam array tag

}

}

}

$tagCounts = array_count_values($tags); // Hitung frekuensi kemunculan setiap tag

arsort($tagCounts); // Urutkan tag berdasarkan frekuensi kemunculan dari yang paling banyak

foreach ($tagCounts as $tag => $count) { // Loop setiap tag dan frekuensi kemunculannya

$tagSize = 15 + ($count * 4); // Tentukan ukuran tag berdasarkan frekuensi kemunculan

echo “<a href=’#’ style=’font-size: ” . $tagSize . “px;’>$tag</a> “; // Tampilkan tag dalam elemen anchor dengan ukuran yang ditentukan

}

?>

</body>

</html>

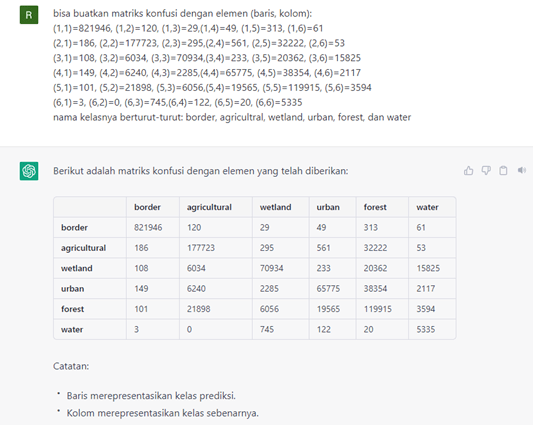

Tampilannya kira-kira seperti ini. Tampak Piala Dunia Indonesia U-20 memiliki frekuensi yang tertinggi di antara kata-kata lainnya. Selamat mencoba.